| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 |

- 머신러닝 논문리뷰

- rnn

- 머신러닝

- Python

- 레이텍

- MNIST

- 뉴럴네트워크

- map

- 이상 현상 탐지

- Deep Neural Network

- 논문 해석

- 이상 탐지

- Generative Model

- anomalydetection

- Snn

- Wavelet Transform

- Machine Learning

- 딥러닝

- Fast Fourer Transform

- 논문리뷰

- 논문 리뷰

- Spiking Neural Network

- autoencoder

- 인공신경망

- ae

- 기계학습

- Bagging

- MLE

- ML

- Deep Learning

- Today

- Total

MATH & ML

논문요약 - Maximum Principle Based Algorithms for Deep Learning[17.10] 본문

논문요약 - Maximum Principle Based Algorithms for Deep Learning[17.10]

BlogYong 2018. 2. 2. 20:53(Qianxiao Li, Long Chen, Cheng Tai, and Weinan E)

이 paper를 읽기 전에 먼저 dynamical system이 어떻게 machine learning에 쓰이는지 감을 잡기 위해 다음 논문을 참고하였다

[2017.03] A Proposal on Machine Learning via Dynamical Systems

(Weinan E)

여기서 대충 감을 잡고 원래의 paper를 읽었다.

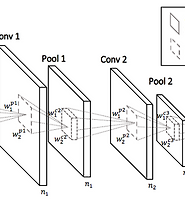

deep learning model을 효율적으로 training하는 방법으로는 stochastic gradient desecnt와 그 응용된 것들이 최근 많이 쓰인다. 하지만 크게 두 가지 문제가 있는데 첫째, 업데이트가 많고 오래 iteration이 돌아야 할 수가있고 둘째, back propagation과 grdient update가 sequential이여서 트레이닝이 동시에 일어날 수가 없다. 따라서 기존의 optimization problem을 새로운 관점으로 해결하려는 시도가 많은데 그 중 하나가 control theory 관점으로 보아서 dynamical system을 적용하여 machine learning 문제들을 해결해보려는 시도이다.

그중에서도 이 paper에서는 control theory & differential equation과 관련된 이론 중 pontryagin's maximum principle(이하 PMP)라는 것이 있는데 이를 이용하여 알고리즘을 개선하였다.

PMP를 numreical 하게 트레이닝 하는 방법에도 여러가지가 있다. 그 여러 알고리즘들(two point boundary value problem 등) 중 많은 방법들이 작은 스케일의 control문제를 푸는것만 가능하며 큰 스케일(많은 state와 control variable)과 관련된 문제들을 해결하기에 좋은 방법 중 하나로 Method of Successive Approximations 라는 방법이 있다.

하지만 이 방법의 문제점 중 하나는 초기 조건이 나쁘면 발산 할 수 있다는 점인데, 이 paper에서는 이를 조금 개선한 Extended Method of Successive Approximations 를 가져와 항상 수렴함을 보였고 이를 discretize한 알고리즘을 이용하여 deep residual network에 적용하여 기존의 방법들과 비교했다. 비교를 위해여 초기값을 flat한 곳이나 saddle point 부근으로 하여 실험을 해보았다.

그 결과 iteration대비 정확도는 기존 방법보다 좋았지만, 역시나 걸리는 시간이 기존 방법에 비해 오래걸렸다.

개선할 점으로는 시간이 오래 걸리는 문제를 어떻게 해결할 것인가 와 pmp를 일반적인 deep-neural-network에 적용가능할지 등이 있다.