| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | |||||

| 3 | 4 | 5 | 6 | 7 | 8 | 9 |

| 10 | 11 | 12 | 13 | 14 | 15 | 16 |

| 17 | 18 | 19 | 20 | 21 | 22 | 23 |

| 24 | 25 | 26 | 27 | 28 | 29 | 30 |

| 31 |

- ML

- 머신러닝

- 머신러닝 논문리뷰

- 논문리뷰

- anomalydetection

- Snn

- MNIST

- 이상 탐지

- Python

- rnn

- Machine Learning

- 이상 현상 탐지

- 뉴럴네트워크

- 기계학습

- 인공신경망

- Generative Model

- Deep Learning

- Bagging

- Deep Neural Network

- Fast Fourer Transform

- 논문 해석

- ae

- MLE

- 딥러닝

- Wavelet Transform

- Spiking Neural Network

- 논문 리뷰

- autoencoder

- 레이텍

- map

- Today

- Total

목록ae (2)

MATH & ML

Variational Autoencoder(VAE)의 원리와 이해

Variational Autoencoder(VAE)의 원리와 이해

Variational Autoencoder(VAE)는 다시 말하지만 기존의 AE 와 태초부터 탄생 배경이 다른데 다 따지고 결국 전체적인 구조를 보니 AE와 주조가 같아서 autoencoder라는 이름이 붙게 된거라고 볼 수 있다.VAE의 목적은 어떤 데이터 X에 대해서 그 X에 영향을 주는 어떤 잠재변수(latent variable) Z가 존재한다고 가정을 하고, 그 Z를 찾아내는데에 목적이 있다. 즉 이 Z를 찾아내면 우리는 기존 트레이닝 데이터에 없지만 의미를 가지는 데이터들을 만들어 낼 수 있다는 것이다. 즉 트레이닝 데이터 각 x에 대해서 p(x)를 최대화 시키고 싶은게 목표이다.$$P(X) = \int_P(X|z)P(z) dz$$ 이 VAE에서 generative model관점으로 살펴보면 그..

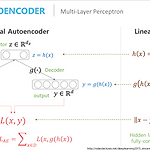

Autoencoder란 개략적 설명과 종류

Autoencoder란 개략적 설명과 종류

Autoencoder는 dimensionality reduction이면서 동시에 non-parametric Density Estimation인데기존의 dimensionality reduction과의 차이 & 기존의 density estimation과의 차이는바로 기존의 방법들이 Nerighborhood based training인데 이 Neighborhood기반의 방법들은 '고차원에서 가까운 애들은 왠만하면 manifold(저차원)에서도 가까울꺼야'라는 가정하에 진행한다. 하지만 고차원일수록 manifold를 잘 찾지 못하면 그 고차원에서의 거리는 실제 우리가 생각하는 거리와 다를 수 있다! 이것이 기존의 방법들과 autoencoder의 차이이다.2000년 초반쯤에 나온 autoencoder는 Deep ..